AI heeft de (digitale) wereld stevig opgeschud. Geen functionaliteit wordt meer aangeboden zonder dat een AI-engine op de een of andere manier er deel van uit maakt. Maar naast de hype zit er natuurlijk ook een werkelijke kracht in, kijk maar naar de diverse voorbeelden en de discussies er omheen. Persoonlijk ben ik van mening dat veel ernstige ziektes in de toekomst opgelost gaan worden door de computer en AI hierin weer een volgende stap is om dit mogelijk te maken. Maar zoals gewoonlijk in de virtuele wereld, is het niet alleen maar hosanna. Sterker nog, ik denk dat AI democratieën in gevaar kunnen brengen.

Kracht AI

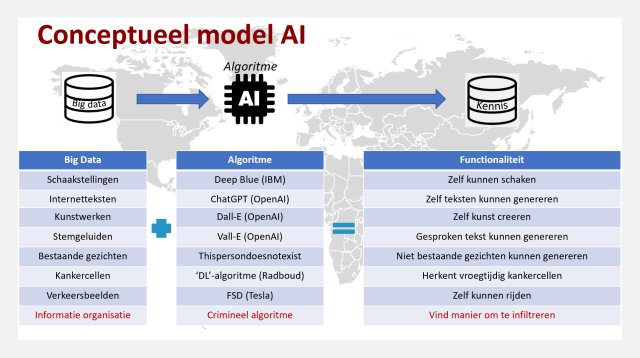

AI is niet nieuw, maar de rekenkracht in combinatie met de enorme hoeveelheid data maakt het op dit moment zo succesvol. Vele onwetenden vergelijken de functionaliteit met de mens want onzinnig is. Maar als we de functionaliteit afstemmen op één specifieke taak, streeft deze het kunnen van de mens al ver voorbij. Denk bijvoorbeeld maar aan schaken waarbij grootmeesters zich niet meer laten vernederen door de schaakcomputer.

Gevaren AI

Inmiddels staat het internet vol met waarschuwingen. Zelfs dat AI het voortbestaan van de mensheid in gevaar kan brengen. Feit is wel dat het niet komt zonder risico’s. Daarom de volgende 5 risico’s in mijn ogen genoemd:

Risico 1: Onduidelijk verdienmodel

Helaas hebben vele bedrijven op het Internet een zeer ondoorzichtig verdienmodel. In sommige gevallen zelfs zelden winstgevend. Daarnaast is de functionaliteit veelal gratis en we weten dat als iets gratis is, dat jij dan het product bent. Maar ook dit heeft alles te maken met het verdienmodel.

Veel bedrijven op het internet verdienen geld met de verkoop van advertenties. Zij weten dat het effect het grootst is als deze advertenties in lijn liggen met de interesses van de potentiële klant. Daarom worden gebruikers geprofileerd zodat aanbieders hierop beter hun producten kunnen afstemmen. Een van de grootere spelers op dit gebied is bijvoorbeeld Google. Al hun producten en geboden functionaliteit staat dan ook in dit teken. Als ik het internet raadpleeg (m.b.v. Chrome), een zoekopdracht geef (via Google.com), een mail stuur (via Gmail), een locatie bezoek (Location enabled) of zelfs praat (Speech-to-Text), word ik geprofileerd. Hiervoor worden diverse demografische kenmerken van mij geregistreerd. Prompt krijg ik ‘spontaan’ reclames in mijn browser die in lijn liggen met mijn profiel. Dit is nog tamelijk onschuldig maar wordt anders zodra er ook gedragskenmerken worden geregistreerd, hoe de gebruiker zich emotioneel uit. Ik durf te beweren dat Google inmiddels ook beter weet waarop je moet stemmen dan jij zelf.

Veel bedrijven op het internet verdienen geld met de verkoop van advertenties. Zij weten dat het effect het grootst is als deze advertenties in lijn liggen met de interesses van de potentiële klant. Daarom worden gebruikers geprofileerd zodat aanbieders hierop beter hun producten kunnen afstemmen. Een van de grootere spelers op dit gebied is bijvoorbeeld Google. Al hun producten en geboden functionaliteit staat dan ook in dit teken. Als ik het internet raadpleeg (m.b.v. Chrome), een zoekopdracht geef (via Google.com), een mail stuur (via Gmail), een locatie bezoek (Location enabled) of zelfs praat (Speech-to-Text), word ik geprofileerd. Hiervoor worden diverse demografische kenmerken van mij geregistreerd. Prompt krijg ik ‘spontaan’ reclames in mijn browser die in lijn liggen met mijn profiel. Dit is nog tamelijk onschuldig maar wordt anders zodra er ook gedragskenmerken worden geregistreerd, hoe de gebruiker zich emotioneel uit. Ik durf te beweren dat Google inmiddels ook beter weet waarop je moet stemmen dan jij zelf.

Risico 2: Zakelijk opportunisme

In de zoektocht naar hogere winsten, is men veelal bereid om grenzen op te zoeken en soms zelfs te overschrijden. Dit moeten we niet onderschatten, kijk maar naar de diverse schandalen uit het verleden, zoals het ‘Cambridge Analytica’-schandaal van Facebook, ‘Wifi-sniffing’ incident van Google, ‘Batterygate’ van Apple en ‘Dieselgate’ van VW.

Artikel: Cambridge Analytica-schandaal van Facebook |

|---|

Zij haalden persoonlijke data uit Facebook om deze vervolgens te gebruiken in de presidentiële campagnes van Donald Trump, zonder dat de personen in kwestie hier expliciet toestemming voor hadden gegeven. Zij haalden persoonlijke data uit Facebook om deze vervolgens te gebruiken in de presidentiële campagnes van Donald Trump, zonder dat de personen in kwestie hier expliciet toestemming voor hadden gegeven. |

Risico 3: Good cause, bad cause

De functionaliteit wordt natuurlijk ontwikkeld met alleen maar goede bedoelingen (good cause). Zelden houden we er rekening mee dat de functionaliteit ook misbruikt kan en zal gaan worden door kwaadwillenden (bad cause). Statelijke actoren en goed georganiseerde criminelen (Advanced Persistant Threaths (APT’s)) zullen de kracht ook zeker inzetten om hun onethische doelen te bereiken.

Risico 4: Data is niet objectief

AI-systemen worden getraind met data, veel data (Big Data). Deze data komt van het Internet en we weten dat daar niet altijd de waarheid te vinden is. Daarnaast hoe groot de dataset ook is, er zit altijd wel enige vorm van vooroordeel in. Deze zitten in de data en dus ook in de uitkomsten. Vooroordelen zijn in het huidige tijdsbeeld zeer onwenselijk, daarentegen niet onoverkomelijk omdat het verleden nu eenmaal vol zit met vooroordelen (denk maar aan ons slavernijverleden). Deze aspecten (feitelijkheid en vooroordelen) zijn dan ook één van de grootste uitdagingen.

Risico 5: Resultaten zijn levensecht

Hetgeen geproduceerd met AI is nauwelijks meer van echt te onderscheiden. In deze kracht schuilt ook direct het grootste gevaar. De eenvoud waarmee fake news, deepfakes en dus des-/misinformatie te produceren zijn, is haast kinderspel geworden. Kwaadwillenden, influencers en zelfs overheden maken er graag gebruik van.

Hetgeen geproduceerd met AI is nauwelijks meer van echt te onderscheiden. In deze kracht schuilt ook direct het grootste gevaar. De eenvoud waarmee fake news, deepfakes en dus des-/misinformatie te produceren zijn, is haast kinderspel geworden. Kwaadwillenden, influencers en zelfs overheden maken er graag gebruik van.

We leven in het informatietijdperk waarin we dagelijks een tsunami aan informatie over ons heen krijgen. Het recht op nieuws is niet meer voorbehouden aan de traditionele media. Zo komt ook veel nieuws tot ons via sociale media. Of een nieuwsbericht nu waar of onwaar is, is voor de gewone consument haast niet meer te onderscheiden.

Omdat (zelfs) overheden steeds minder transparantie betuigen en de manipulatie ook niet schuwen wordt in toenemende mate getwijfeld aan de juistheid van de berichtgeving. Hierdoor neemt het vertrouwen in overheden steeds meer af. Gezien de rol van AI in het creëren van des-/misinformatie draagt het hier letterlijk aan bij waardoor het een gevaar wordt voor democratieën.

Mensen zijn veelal doomdenkers. Haast dagelijks hoor je dat AI banen zal gaan kosten. Maar zoals gebruikelijk met dergelijke revolutionaire technologieën zal er een verschuiving van banen plaats vinden. Ik kan mij zo voorstellen dat er ook nieuwe banen ontstaan. Wat te denken van een digitale archeoloog, een functie die zoekt naar juistheid en authenticiteit.

Don’t loose your trust and be aware of the opportunism

Elk land wil haar informatiepositie verbeteren. Dit gebeurt veelal heimelijk via spionage. Het cyber domein leent zich hier uitermate goed voor. Maar grootmachten leggen de inwinning van informatie zelfs vast in een wet. Zo kent China de Nationale Inlichtingenwet (art.7) waarin elke Chinese organisatie en burger verplicht wordt om informatie over te dragen aan haar inlichtingendienst. Niet uniek omdat Amerika de CLOUD ACT kent, een wet waarin inlichtingendiensten toegang hebben tot data bij Amerikaanse bedrijven ongeacht of fysiek deze nu binnen of buiten de staatsgrenzen bevinden. Deze laatste ligt zeer gevoelig voor ons Nederlanders omdat Europa grootgebruiker is van Amerikaanse Cloudproviders.

Elk land wil haar informatiepositie verbeteren. Dit gebeurt veelal heimelijk via spionage. Het cyber domein leent zich hier uitermate goed voor. Maar grootmachten leggen de inwinning van informatie zelfs vast in een wet. Zo kent China de Nationale Inlichtingenwet (art.7) waarin elke Chinese organisatie en burger verplicht wordt om informatie over te dragen aan haar inlichtingendienst. Niet uniek omdat Amerika de CLOUD ACT kent, een wet waarin inlichtingendiensten toegang hebben tot data bij Amerikaanse bedrijven ongeacht of fysiek deze nu binnen of buiten de staatsgrenzen bevinden. Deze laatste ligt zeer gevoelig voor ons Nederlanders omdat Europa grootgebruiker is van Amerikaanse Cloudproviders.